Maßnahmen gegen Falschmeldungen: Facebook sagt Fake News Kampf an

Facebook hat einen Plan vorgelegt, wie es gegen Falschmeldungen vorgehen will. Zunächst bleibt es bei einer Testphase in den USA.

Facebook begibt sich auf die Suche nach Falschmeldungen Foto: reuters

BERLIN taz | Facebook hat am Donnerstag Maßnahmen vorgestellt, wie es die Verbreitung von Falschmeldungen eindämmen möchte. Kritiker_innen hatten dem US-Unternehmen zuvor vorgeworfen, Donald Trump indirekt zum Wahlsieg verholfen zu haben. Im Finale des US-Wahlkampfs seien die zehn meistgeteilten Geschichten auf Facebook Fake-News gewesen.

Falsche Nachrichten werden nicht nur als Propaganda-Mittel aus politischem Interesse, sondern auch aus Profit-Zwecken verbreitet. Texte, die Empörung provozieren, verbreiten sich schnell und werden häufig als Hetze beispielsweise gegen Geflüchtete genutzt.

Facebook-Gründer Mark Zuckerberg wies die Vorwürfe zunächst zurück, Trump zum Sieg verholfen zu haben, und verneinte, dass Facebook ein Problem mit Falschmeldungen habe – nur um kurz später zu verkünden, dass Strategien gegen die Verbreitung von Fake-News erarbeitet würden.

In einem Blogpost fasste Adam Mosseri, zuständig für den Bereich Newsfeed bei Facebook, am Donnerstag das Projekt gegen Falschmeldungen in vier Schritten zusammen. Dabei wies er die Verantwortung Facebooks für das Entstehen und Verbreiten von Fake-News zumindest teilweise zurück: „Wir glauben daran, den Menschen eine Stimme zu geben, und können dabei nicht die Schiedsrichter der Wahrheit werden.“ Bei ihrem Test beschränke sich das Unternehmen daher auf die „schlimmsten der schlimmen“ Falschmeldungen.

Die erste Maßnahme des Unternehmens soll es Nutzer_innen in Zukunft erleichtern, Posts zu melden, die ihnen als Falschnachrichten erscheinen. Bislang musste man bei einer Meldung unter drei vorgegebenen Gründen („Es ist nervig oder uninteressant“, „Es sollte meiner Meinung nach nicht auf Facebook sein“, „Es handelt sich um Spam“) entscheiden. Die vierte Auswahlmöglichkeit – „Es ist eine Falschmeldung“ – soll in der Testphase hinzugefügt werden.

Kennzeichnung „umstrittener“ Posts

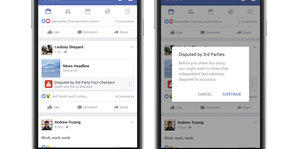

Diese Meldungen und „andere Signale“, die in Mosseris Post nicht näher erläutert werden, sollen von Dritten geprüft und gegebenenfalls mit einem Button „umstritten“ gekennzeichnet werden. ABC News und PolitiFact sowie 41 weitere Redaktionen sollen die Faktenlage der gemeldeten Beiträge überprüfen. Die 43 Organisationen gehören dem International Fact-Checking-Network (IFCN) des Poynter-Instituts for Media Studies an und haben den „Fact Checkers Code of Priniciples“ unterschrieben.

Haben die Organisationen einen Post als „umstritten“ gekennzeichnet, wird dieser nicht gelöscht, doch landet er im Newsfeed weiter unten und kann nicht mehr gegen Bezahlung beworben werden. Mosseri argumentiert, dass dieses Verfahren den User_innen mehr Kontext liefere und ihnen dabei helfe zu entscheiden, ob sie einen Post teilen möchten oder nicht.

Anhand von Nutzerstatistiken möchte Facebook die Position der Nachrichten im Newsfeed anpassen. Dabei nimmt Facebook an, dass Artikel, die viel gelesen und wenig geteilt werden, „irreführende“ Inhalte haben müssen und demnach Falschmeldungen sind. Auch diese Posts würden dann eine geringere Gewichtung erfahren und im Newsfeed weiter unten erscheinen.

Der letzte Schritt soll Betrüger_innen das absichtliche Verbreiten von Fake-News erschweren. Gefälschte Internetadressen, die aussehen wie die Adressen bekannter Medienorganisationen, verbreiten Falschmeldungen aus einem finanziellen Interesse. Mit Fake-News ködern sie Nutzer_innen auf ihre Website, die sich in vielen Fällen dann als Werbeseite herausstellt. Dies widerspricht den Nutzerbedingungen Facebooks. Mit stärkerer Kontrolle möchte Facebook gegen diese Betrüger_innen vorgehen und ihnen den Zugang zu Facebook sperren.

Pilotprojekt in den USA

Bei den vier Maßnahmen, die nun ergriffen werden sollen, handelt es sich zunächst jedoch nur um ein Pilotprojekt, das auf die USA beschränkt bleibt. Dabei gibt das Unternehmen einen Großteil der Verantwortung ab – an außenstehende Redaktionen und an die Vernunft und Eingriffe der Nutzer_innen.

Ob der Testlauf zu weniger Falschmeldungen auf der Plattform führen und auf andere Länder übertragen wird, muss sich erst noch zeigen. Fraglich bleibt auch, ob mithilfe der Nutzerstatistiken Falschmeldungen verhindert werden können. Denn gerade gefälschte Nachrichten werden häufig gelesen und geteilt, wie der US-Wahlkampf gezeigt hat.

Auch in Deutschland wird die Kritik am Umgang Facebooks mit Falschmeldungen immer lauter. Bundesjustizminister Heiko Maas droht nun mit Bußgeldern als letzte Maßnahme, wenn gefälschte Nachrichten und Hassbotschaften nicht zeitnah gelöscht werden. Gegenüber der Süddeutschen Zeitung forderte er am Donnerstag, Facebook müsse seine „gesellschaftliche Verpflichtung“ als eine Plattform wahrnehmen, auf der kein Platz für „Beleidigungen, Volksverhetzung oder Verleumdung“ sei.

Leser*innenkommentare

10236 (Profil gelöscht)

Gast

"International Fact-Checking-Network "

Wird's zufälligerweise auch von George Soros (mit)finanziert?

Echt, hat nur 1 Monat nach der US-Wahl gedauert, bis der Mann festgestellt hat, dass paar Hundert "liberale" und "progressive" Medienoutlets doch nicht reichen. Kontrolle muss her...

Vidocq

Das ist ein fragiles Ansinnen, aus der Ohnmacht geboren. Wenn ich publiziere 'ich glaube dass von staatlichen Stellen Chemtrails zur Beeinflussung benutzt werden' wäre die Fakemeldung von dem Recht auf Meinungsfreiheit gedeckt.

Wenn ich Verschwörungstheoretiker wäre, adelte ich mich selbst sogar damit, dass ich meine Anschauungen als Fälschungen überschreibe und mich damit als Märtyrer auch noch populär machte.

Ansonsten würden viele auf Legenden basierende Religionen eine Weiterveröffentlichung ihrer Anschauungen gesetzlich bedroht werden.

Und nicht zuletzt die Satire wäre bedroht; Prozesse um die Klärung, was Lüge und was Spekulation ist aber würden (Beispiel Reichsbürger) durch sinnlose Prozesse unnötig aufgewertet werden.